Le lexique de l’IA

Les machines peuvent-elles apprendre comme les humains ou qu'est-ce que l'apprentissage machine ?

Définition de l’apprentissage machine

Reportons-nous aux définitions du Massachusetts Institute of Technology de Boston [1]

( référence utilisée par l’Organisation Mondiale de la Santé) [2].

Définition du MIT.

« Les algorithmes d’apprentissage-machine utilisent les statistiques pour retrouver des motifs au sein de quantités massives de données. Les données englobent beaucoup de choses - nombres, mots, images, clicks, etc… Tout ce qui peut être stocké numériquement peut alimenter un algorithme d’apprentissage machine ». [1]

Définition de Daniela Rus, professeur d’informatique et intelligence artificielle au MIT.

« L’apprentissage machine est un processus qui part d’un corps de données et ensuite essaie de déduire des règles ou des procédures qui soit expliquent les données, soit prédisent de futures données».[3]

Quelques explications complémentaires

L’informatique utilise une information écrite en langage binaire. Une donnée numérisée ( on dit aussi digitale, qui est un synonyme) est une information codée en mode binaire.

Le langage binaire est un code qui ne comprend que 2 symboles, les chiffres zéro et un. Ainsi, toute information entrant dans un ordinateur se présente sous la forme d’une succession de 0 et de 1. Cette même succession de 0 et de 1 dessine des motifs au sein de la base de données. Par exemple, le chiffre 2 en binaire s'écrit 10 (lire "un, zéro" et non "dix"). L'élément "10" est le motif du chiffre 2 que l'on retrouvera partout où l'on aura écrit "2" dans la base de données.

L'apprentissage machine, et plus largement l'intelligence artificielle, c'est fabriquer un algorithme informatique capable de reconnaître des motifs au sein de cette succession de 0 et de 1. Le terme de motifs doit être compris exactement dans le même sens que ceux d'un dessin ou d'une broderie, c’est-à-dire des éléments qui se répètent et se ressemblent.

Lorsque les mêmes motifs se retrouvent dans des jeux de données différents, on peut les classer dans la même catégorie. Par exemple, si on veut reconnaître des reins sur des images de scanner, l’ordinateur va repérer la répétition de la même forme approximative en haricot caractéristique du rein. La forme en haricot est un motif. Toutes les images pour lesquelles ce motif aura été repéré seront classées dans la même catégorie.

L’ordinateur « apprend » donc à distinguer des motifs au sein des données, puis, en recherchant l’existence de ce motif dans d’autres jeux de données les classe comme appartenant à la même catégorie.

Il s’agit donc de savoir si les motifs repérés sont liés entre eux par une relation quelconque. Pour ceci, on réalise des calculs statistiques, raison pour laquelle le MIT résume la définition de l’intelligence artificielle à la réalisation de statistiques.

Les 3 types d’apprentissage machine

Le MIT distingue 3 types d’apprentissage machine : l’apprentissage supervisé, l’apprentissage non supervisé, l’apprentissage par renforcement. Chacun est défini de la façon suivante.

Apprentissage supervisé.

« Les données sont étiquetées pour dire à la machine quels motifs exactement elle doit rechercher. C’est ce que vous faites sur Netflix quand vous appuyez sur « play » pour démarrer une série : vous dites à l’algorithme de rechercher des séries similaires. »

Apprentissage non supervisé.

« Dans l’apprentissage non supervisé, les données n’ont pas de label. La machine recherche simplement tous les motifs qu’elle peut retrouver. C’est comme laisser un chien sentir des tonnes d’objets différents et les trier en groupes d’odeurs similaires ».

Apprentissage par renforcement.

« Un algorithme d’apprentissage par renforcement apprend par essais et erreurs pour atteindre un objectif clair. Il essaye plein de choses différentes et est pénalisé ou récompensé selon que ses comportements l’aident ou l’empêchent d’atteindre son objectif. C’est comme donner et retenir des friandises lorsque l’on enseigne un nouveau tour à un chien. L’apprentissage par renforcement est la base d’Alphago de Google, le programme qui a battu les meilleurs joueurs humains au jeu de go ».

Quelques explications complémentaires

L’essentiel de l’intelligence artificielle, et particulièrement en médecine, est de l’intelligence artificielle supervisée. On emploie ce terme car la machine ne découvre pas les choses par elle-même, elle « apprend » à partir de données dites étiquetées. De quoi s’agit-il ?

Prenons l’exemple d’un système que l’on souhaite programmer pour reconnaître des chats sur des photographies. Pour cela, on va utiliser une base de données composée de milliers de photos de chats préalablement marquées comme étant des chats. On oriente donc la machine vers ce qu’elle doit rechercher. Pour effectuer une comparaison simple, nous sommes dans la situation de l’imagier des enfants où chaque image porte un titre avec l’animal représenté: la poule, le chien etc..

Dans l’apprentissage non supervisé, l’algorithme essaie d’identifier des éléments communs pour séparer les données en groupes. Reprenons l’exemple de la forme du rein. En apprentissage supervisé, l’algorithme dispose de formes de référence (les images labellisées) et doit comparer la forme des images qu’on lui donne. Il recherche si statistiquement, les nouvelles images ressemblent à celles qu’il connaît. Dans l’apprentissage non supervisé, il n’y a pas d’image de référence. L’algorithme repère dans l’arrangement des données des motifs qui se ressemblent (par exemple la forme du rein qui se retrouve approximativement être la même sur les différentes images) et regroupe toutes les images correspondantes dans la même classe. Au final, il aura donc identifié un lien entre des groupes de données. Cette méthode est utile pour analyser et comprendre une base de données.

L’apprentissage renforcé, quant à lui, est une technique adaptée à la prise de décision. C'est le cas des jeux. Face à une situation, l’algorithme prend une décision (avancer un pion par exemple). Dans tous les cas, on donne à la machine le résultat de son action: gagnant ou perdant). Par la suite, à chaque nouvelle situation, l’algorithme recherche dans sa mémoire s’il a déjà été confronté à la même chose. Si oui, la machine agit en fonction. Par exemple, si précédemment, elle a perdu, l'algorithme essaie une autre solution. A nouveau, on indique à la machine si l'algorithme a eu raison ou tort. Et ainsi de suite, jusqu’à obtenir une IA capable de prendre à chaque fois la bonne décision.

Les machines apprennent-elles ou peuvent-elles apprendre comme les humains?

« Les machines nous dépasseront car elles sont plus performantes que le cerveau humain ».

Cette petite phrase a envahi le débat public et, avec toute la force invincible des idées reçues, a fini par convaincre la majorité. Mais qu’en est-il vraiment? Existe-t-il une réelle justification scientifique à une telle affirmation ?

Essayons de nous orienter à partir de quelques pistes de réflexion.

Apprentissage et intelligence sont intimement liés. Pas d’intelligence sans apprentissage.

En première lecture, on peut donc se dire que si les machines obtenaient, un jour prochain, la capacité d'apprendre comme les humains, elles pourraient nous surpasser. L’argumentation repose sur une comparaison de performance entre ordinateur et cerveau humain. Dans cette idée, la victoire au jeu de Go est avancée comme un événement fondateur. Mais l’intelligence est-elle une simple affaire de vitesse de calcul et d’efficacité de réseaux de neurones dans des tâches précises?

Pour trouver des éléments de réponse, laissons de côté un instant le strict cadre de l’informatique et de la neurobiologie et tournons notre regard vers d’autres sciences, qui, elles aussi, se penchent sur l’intelligence humaine: la psychologie et la paléo-anthropologie.

L’une, la psychologie nous apprend de quelle manière nos comportements et nos décisions sont le fait de nos interactions avec les autres. La seconde, la paléo-anthropologie, nous montre que l’évolution humaine est un processus bio-culturel qui a progressivement émergé, sur des centaines de milliers d’années, à partir du langage, de la technologie et de la complexité sociale.

Dans le fond, toutes les 2 nous disent la même chose. C’est en faisant société, en s’associant les uns aux autres, que les système nerveux centraux des humains ont produit l’intelligence.

Ainsi, si elle est bien produite par le cerveau et ses neurones, l'intelligence humaine est en réalité collective.

Dès lors, il faut s'interroger. Les machines peuvent-elles apprendre comme les humains et développer une intelligence autonome sans faire société ? Inversement, si l’on se dit qu’intelligence et complexité sociale sont liées, comment les machines peuvent-elles faire société? Et quel intérêt pour elles? Car n’oublions pas que, dans le vivant, l’association des individus remplit une fonction en favorisant la survie de l’espèce et l'adaptation au milieu environnant.

Est-il donc réellement crédible de parler d'intelligence autonome des machines sans se poser ces questions fondamentales?

Mais laissons-là ces interrogations et retournons à l’informatique et à la comparaison ordinateur-cerveau.

Les humains, tout comme les animaux apprennent à partir des sensations transmises au cerveau par le système nerveux sensitif. Si l’on veut utiliser une image informatique, nous pouvons dire que les « données » entrantes du cerveau proviennent du monde environnant. Notre « base de données » est le monde réel, tel qu’il est, tout au moins tel qu’il apparaît à nos sens. Ces derniers alimentent le cerveau en permanence.

La position de l’ordinateur est bien différente. Son « monde » n’est pas le monde réel. Il est celui des documents produits par l’activité humaine, et encore pas tous, uniquement ceux qui ont été numérisés. Par son origine et sa composition, le « monde des ordinateurs » n’est qu’un reflet restreint et déformé de la réalité.

Nous pouvons le comparer à une bibliothèque. Comme toute bibliothèque, elle contient des documents de valeur très inégale: certains sont des documents scientifiques sérieux et exacts, d’autres sont anciens et obsolètes, d’autres encore sont des inventions (romans, histoires humoristiques…).

Pour conclure

L’intelligence et la conscience humaines sont des fonctions biologiques, nées de l’évolution du vivant et du système nerveux puis de la vie collective d'homo sapiens. Notre système nerveux nous intègre à notre environnement et nous permet de prendre connaissance du monde réel. C’est lui qui fournit les sensations à la base de notre apprentissage.

Il n’est pas suffisant de comparer la vitesse de calcul des ordinateurs avec le délai de réponse du cerveau dans des tâches ciblées pour proclamer que les machines ont pris le chemin de l’intelligence autonome. Ce point de vue présente de nombreuses incohérences en occultant des traits essentiels de l’intelligence humaine complètement inaccessibles aux ordinateurs (caractère collectif, alimentation du cerveau par le système nerveux sensitif connecté au monde réel).

L’apprentissage-machine est une avancée technique réelle qui démultiplie les capacités de nos ordinateurs et nous donne chaque année de nouveaux appareils qui, au sens propre révolutionnent notre quotidien. Mais les machines n’en deviennent ni conscientes, ni intelligentes autonomes pour autant.

Le terme d’apprentissage machine doit être entendu comme une métaphore. Il n’est pas gênant de l’utiliser, dès l’instant où l’on sait ce que l’on y met, à savoir un terme informatique et que l’on ne fasse pas de comparaison inadaptée avec le cerveau humain.

Bibliographie

[1] Karen Hao, What is machine learning ? MIT Technology Review, 17 nov 2018

[2] Ethics and governance of artificial intelligence for health - Organisation Mondiale de la Santé- juin 2021

[3] Daniela Rus. AI, a vector for positive change in medicine. In Santé et intelligence artificielle. Sous la direction de Bernard Nordlinger et Cédric Villani. CNRS Editions, Paris, 2018.

Références

Sur l'intelligence humaine, 2 références qui ont inspiré ma réflexion:

Olivier Houde. L'intelligence artificielle n'est pas un algorithme. Paris, Odile Jacob. 2019

Les cours de Jean-Jacques Hublin, titulaire de la chaire de paléo-anthropologie du Collège de France.

QU'EST-CE QUE L'INTELLIGENCE ARTIFICIELLE?

Définition de l’Organisation Mondiale de la Santé.

« L’Intelligence artificielle correspond à la capacité d’algorithmes encodés dans des technologies qui apprennent de données pour ensuite exécuter des tâches sans que chaque étape du processus ait été programmé explicitement par un humain ». (1)

Définition du conseil sur l’intelligence artificielle de l’OCDE

« Système automatisé qui, pour un ensemble donné d’objectifs définis par l’homme, est en mesure d’établir des prévisions, de formuler des recommandations, ou de prendre des décisions influant sur des environnements réels ou virtuels. Les systèmes d’IA sont conçus pour fonctionner à des degrés d’autonomie divers. » (2)

COMMENTAIRE DE LA REDACTION

Ce qu’il faut retenir de ces définitions est la chose suivante: l’intelligence artificielle, c’est de l’informatique.

Il était d’usage, les années précédentes, de définir l’IA comme la reproduction de fonctions du cerveau humain. Cette présentation historique date des années 50, à la naissance de l’IA, lorsque ses pionniers se fixèrent comme objectif de reproduire le cerveau humain. Cette idée a atteint un point culminant autour de 2015 avec les exploits du deep-learning. L’ « optimisme technologique » de ces années a depuis été tempéré. Si l’IA est une belle avancée pour les logiciels qui font fonctionner nos appareils numériques, ils sont bien loin d’être capable de prendre conscience et de supplanter la pensée humaine!

De nos jours, l’intelligence artificielle est très répandue et présente dans presque tous les dispositifs numériques. Lorsque vous parlez à votre smartphone pour lui faire exécuter une tâche, vous utilisez la reconnaissance vocale qui est un champ de l’IA.

Mais qu’est-ce qui différencie un simple programme informatique d’une intelligence artificielle?

Un programme informatique « classique » est totalement rédigé par un informaticien programmeur. Ceci veut dire que chaque instruction exécutée par l’ordinateur a été rédigée préalablement. L’ordinateur n’a aucune autonomie et exécute ce qu’il lit.

Un programme « intelligent artificiel » est partiellement rédigé par le programmeur. Le programmeur fixe un objectif à la machine, fournit des données et une trame et l’ordinateur trouve seul le chemin pour remplir l’objectif en créant son propre algorithme. Il s’auto-programme. Ceci est possible grâce à l’apprentissage-machine.

La suite de la série "Le lexique de l'IA"

Les machines peuvent-elles apprendre comme les humains ou qu'est-ce que l'apprentissage machine ?

Neurone biologique et neurone artificiel

Références

(1) Ethics and governance of artificial intelligence for health. WHO Guidance. Juin 2021.

https://www.who.int/publications/i/item/9789240029200

(2) OCDE, Recommandation du conseil sur l’intelligence artificielle, OECD/LEGAL/0449 paru en 2021

https://legalinstruments.oecd.org/en/instruments/OECD-LEGAL-0449%23mainText

Neurone biologique et neurone artificiel

De la même manière que nous parlons d’intelligence artificielle, nous utilisons également le terme de « neurone artificiel ». Il s'agit d'un programme informatique qui se construit selon le schéma de fonctionnement du neurone biologique.

Qu’est-ce qu’un neurone artificiel? Peut-on le comparer à un neurone du cerveau? Nous décrivons brièvement l’un et l’autre avant de nous pencher sur cette question.

QU’EST-CE QU’UN NEURONE « BIOLOGIQUE »?

Le neurone, que nous dénommerons par la suite « neurone biologique » pour le distinguer du « neurone artificiel » des informaticiens, est une cellule spécialisée de l’organisme. Il est l’unité de base de notre cerveau qui en contiendrait 86 milliards. Assemblés en réseau, les neurones donnent naissance à la pensée humaine et à ce que nous nommons intelligence. Mais ils ne sont pas les seules cellules du cerveau. D’autres types cellulaires jouent un rôle fondamental et participent au processus neuronal. Sans eux, les neurones ne pourraient exister.

Mais seuls les neurones, ou plus exactement leurs propriétés électriques, ont inspiré les inventeurs du « neurone artificiel ». En effet, le neurone biologique a la particularité de produire, sous certaines conditions, un signal électrique et de le transmettre. C’est par ce signal électrique que se fait la diffusion du message nerveux.

Décrivons le phénomène électrique du neurone plus en détail.

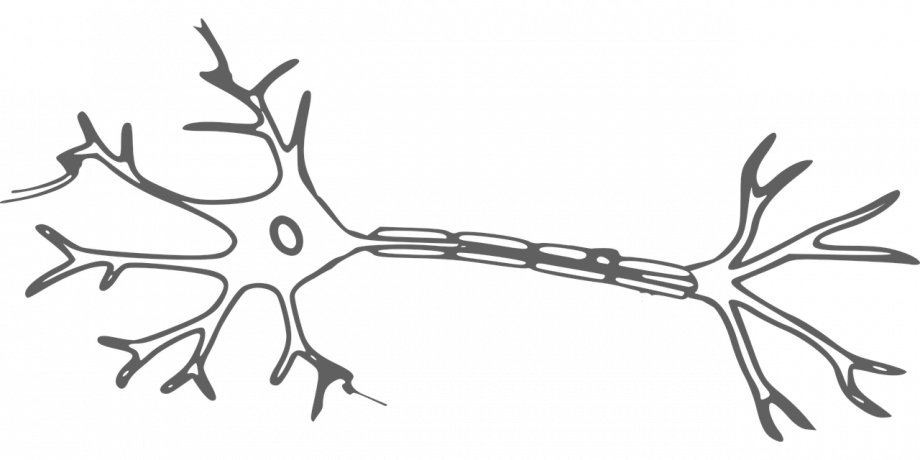

Observons le dessin ci-dessous.

Les dendrites

↓

Le corps cellulaire

↓

L’axone

↓

Repérez, dans la partie gauche, l’élément étoilé. Il s’agit du corps cellulaire du neurone. Vers lui convergent des éléments ramifiés, ce sont les dendrites (elles sont au nombre de 5 sur le dessin). Du corps cellulaire, se dirigeant vers la droite, l’axone. A son extrémité, l’axone se ramifie en plusieurs expansions (au nombre de 4 sur le dessin). Au bout de ces extrémités, les synapses.

LE NEURONE EN QUELQUES MOTS

Dendrite. Le neurone est une cellule en relation avec l’extérieur par le biais de ses dendrites. Les dendrites forment donc « l’entrée » du neurone. Elles sont en très grand nombre. Les dendrites réagissent aux événements environnants. Il peut s’agir de la perception de lumière au niveau des yeux, de pression au niveau de la peau, par exemple. Un tel événement, issu de l’ environnement et capable de déclencher une réaction du dendrite est appelé stimulus.

Le champ des stimuli capables de faire réagir nos neurones est vaste. En fait, il s’agit de tout ce qui se produit à l’intérieur et à l’extérieur de notre corps.

La dendrite réagit en créant une décharge électrique, également appelée potentiel d’action, dirigée vers le corps cellulaire.

Corps cellulaire. Il reçoit les influx électriques provenant de toutes les dendrites. A ce niveau, se réalise une sommation de l’intensité de tous les influx reçus. Si la somme dépasse un certain seuil, la décharge électrique est transmise à l’axone.

Excitation supra-liminaire

Tous les influx électriques des dendrites convergent vers le corps cellulaire. A cet endroit, ils viennent s’ajouter les uns aux autres. Ainsi se réalise une sommation de leur intensité.

Les influx électriques parvenus au niveau du corps cellulaire ne sont pas transmis à l’axone systématiquement. Il existe une condition. L’intensité détectée à l’origine de l’axone doit dépasser un certain seuil. En dessous, le message des dendrites est ignoré. Au-dessus, il déclenche une excitation électrique qui se propage tout le long de l’axone, jusqu’à ses synapses. On parle d’excitation supra-liminaire.

Axone. C’est la voie de sortie unique du neurone, « la voie finale commune ». Il se ramifie en de multiples expansions qui le lient à d’autres cellules, via les synapses. Ainsi, se diffuse l’information vers l’extérieur du neurone.

Synapse. C’est l’endroit ou se fait la connexion entre 2 neurones, donc entre une dendrite et un axone. Anatomiquement, il s’agit d’une fente. L’une de ses berges est la terminaison d’un axone, l’autre est l’origine d’une dendrite. L’axone d’un neurone est donc lié à la dendrite du neurone suivant.

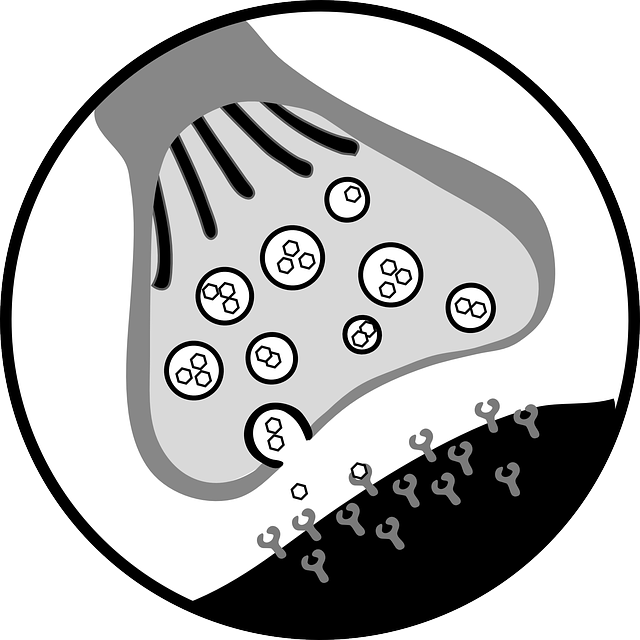

Ci-dessous, le schéma d'une synapse. En haut du dessin, la terminaison de l'axone. Elle contient des vésicules de neurotransmetteurs. Les vésicules sont représentées par les cercles. Les neurotransmetteurs, par les petits hexagones dessinés à l'intérieur des cercles. La vésicule fusionne avec la membrane de l'axone et relargue les neurotransmetteurs dans la fente synaptique. En face de l'axone, la dendrite du neurone suivant. Elle est représentée en noir sur le dessin. Elle contient des récepteurs qui fixent les neurotransmetteurs. Ils sont représentés par les petites tiges grises. La fixation provoque la formation d'un courant électrique au niveau de la dendrite.

Neurotransmetteur

Un neurotransmetteur est un composé chimique produit par le neurone. Il est relâché dans la fente synaptique par l’axone, sous l’effet du potentiel d’action (la décharge électrique). Il existe un grand nombre de neurotransmetteurs. Ce sont eux les vrais agents du message nerveux. Leur variété nous donne la diversité d’action nécessaire à notre adaptation au milieu environnant. Si l’intelligence artificielle est électrique, l’intelligence humaine est, elle, chimique!

Information. Le concept d’information transmis par le neurone peut être un peu vague. Essayons de l’éclaircir. L’information est l’ensemble des phénomènes électriques et chimiques qui se propagent à travers le neurone en réaction à un événement environnant. Elle est créée sous forme électrique au niveau des dendrites et se propage à l’axone via le corps cellulaire. Mais, au niveau de la terminaison de l’axone, l’influx électrique déclenche la sortie de neurotransmetteurs. Ces neurotransmetteurs se fixent sur la dendrite située sur l’autre versant où ils déclenchent un influx électrique dans le neurone suivant. Au niveau de la synapse, l’information a donc pris une forme chimique.

Retenons également que l’information ne circule que dans un seul sens, des dendrites vers l’axone. La dendrite reçoit le signal, l’axone le diffuse.

QU’EST-CE QU’UN NEURONE ARTIFICIEL?

Le neurone artificiel n’est pas un objet physique vivant mais une procédure informatique qui se déroule selon un schéma d’enchainement d’évènements inspiré du neurone biologique.

LE NEURONE ARTIFICIEL EN QUELQUES MOTS

Entrée

En informatique, une entrée est l’information que l’on donne à traiter à un ordinateur. Ainsi, si voulez faire apparaître la lettre « a » sur l’écran, vous appuyez sur la touche « a » du clavier. C’est la donnée d’entrée. Vous noterez d’ailleurs que pour l’envoyer à l’ordinateur, vous appuyez sur la touche « entrée » du clavier.

Sortie

La sortie est le résultat de la procédure informatique déclenchée par l’entrée de données. L’affichage de la lettre « a » après avoir appuyé sur la touche correspondante du clavier est un exemple.

L’entrée du neurone artificiel: les poids synaptiques

Dans le neurone biologique, toutes les informations transmises au corps cellulaire par les dendrites n’ont pas la même importance. Imaginons un neurone à 5 dendrites. Si chacun était équivalent, il compterait pour 20% de l’intensité finale. Mais ce n’est pas le cas. Une dendrite peut représenter 5%, une autre 50% etc.. Chaque dendrite a donc un « poids » différent dans l’intensité finale.

Les informaticiens ont repris cette propriété physiologique pour élaborer le concept de neurone artificiel. Ainsi, chaque donnée fournie en entrée au neurone artificiel se voit attribuer un coefficient selon l’importance qu’on lui attribue dans la détermination du résultat final. Ce coefficient est le « poids synaptique ».

Pourquoi utiliser le terme de synapse?

Au niveau du cerveau, chaque neurone est connecté à d’autres neurones par ses dendrites. Nous l’avons vu plus haut, la synapse est l’endroit où se fait le lien entre l’axone du neurone émetteur et la dendrite du neurone récepteur. Dans un réseau de neurone artificiel, le résultat de sortie sera la donnée d’entrée du neurone artificiel suivant, à l’image de ce qui se passe dans le cerveau. Les informaticiens ont donc repris ce terme de synapse pour désigner la procédure informatique de présentation de donnée à un neurone artificiel.

Le « corps cellulaire » du neurone artificiel: une fonction mathématique

Cette fonction mathématique est appelée « fonction d’activation », par analogie avec le potentiel d’action du neurone.

En effet, elle ne se déclenche que si le seuil d’activation du neurone artificiel est atteint. Chaque neurone artificiel possède le sien. Nous l’avons vu plus haut, les données d’entrée sont affectées d’un coefficient. L’étape suivante est d’additionner tous les signaux reçus en entrée, chacun étant pondéré par son coefficient. Si la somme dépasse le seuil d’activation, alors la fonction mathématique est déclenchée, avec pour variables les données d’entrée.

Le résultat produit est la sortie du neurone artificiel. Ce résultat déclenche une action de l’ordinateur. C’est cette action que l’on assimile à la décharge d’un axone car le « neurone artificiel» ne produit un résultat que si un « seuil d’activation » a été atteint.

PEUT-ON ASSIMILER LE NEURONE ARTIFICIEL A UN NEURONE BIOLOGIQUE ET COMPARER LES 2 ?

Le neurone biologique est une cellule vivante dont la production au cours de la vie embryonnaire est inscrite dans notre patrimoine génétique, hérité de quelques 3,5 milliards d’années d’évolution de la vie sur Terre.

L’assemblage complexe des neurones forme le système nerveux et représente l’interface entre notre corps et le monde extérieur. Dans un processus dont nous ignorons presque tout, il a généré la conscience. Celle-ci reste un événement biologique dont on ne voit pas très bien par quel mécanisme il pourrait être reproduit expérimentalement. En effet, elle est produite par l’interaction des neurones et des autres cellules de l'organisme par l'intermédiaire de molécules chimiques, les neurotransmetteurs. Au sein du neurone, la transmission de l’information est électrique. Elle a inspiré le « neurone artificiel ». Mais la conduction électrique n’est pas l’identité du neurone biologique. Celle-ci est déterminée par les neurotransmetteurs qu’il est capable de décharger.

Le neurone artificiel n’a pas de réalité physique ni de propriété biologique. Bien qu’il permette à un ordinateur de s’auto-programmer, il faut toujours avoir à l’esprit qu’il est lui-même un programme informatique qu’il a fallu écrire en amont. Il n’est doté d’aucune propriété qui lui donnerait la capacité de regarder et d’interpréter le monde par lui-même pour évoluer vers un être doué de conscience.

Neurone biologique et neurone artificiel n’ont rien à voir l’un avec l’autre. Il n’y a pas lieu de les comparer comme 2 entités naturelles qui pourraient être confrontées. Le vivant peut inspirer l’informatique. L’informatique peut aider à comprendre le vivant. Mais la production de copies conformes du vivant par informatique reste du domaine de la science-fiction

POUR EN SAVOIR PLUS

Sur le neurone biologique. 2 très belles références, remarquables par leur clarté.

A lire. Le cours "Physiologie du neurone" du Pr Jacques Coget de l'université de Lille. Vous y trouverez en particulier des explications très claires sur la conduction électrique du neurone.

A voir. La video consacrée à l'influx nerveux du site neuromatiq, par le Dr Ben Brahim Mohammed, de l'université de Fès.

Sur le neurone artificiel

Je vous conseille l'ouvrage de Jean-Claude Heudin, "Comprendre le Deep Learning, une introduction au réseaux de neurones".

Il s'agit, et de très loin, de la meilleure référence sur le sujet.

Liens vers les autres articles du lexique de l'IA en santé

LEXIQUE DE L'IA EN SANTE : QU'EST-CE QUE L'INTELLIGENCE ARTIFICIELLE?

LEXIQUE DE L'IA EN SANTE: QU'EST-CE QU'UN AGENT CONVERSATIONNEL?

LEXIQUE DE L'IA EN SANTE : QU'EST-CE QUE L'APPRENTISSAGE MACHINE?

LEXIQUE DE L'IA EN SANTE: QU'EST-CE QUE LE DEEP LEARNING ?